Runway ได้ปล่อยตัวอย่างเครื่องมือ AI รุ่นใหม่ล่าสุด ลื่นไหล สมจริง และ “ดีกว่า Sora” ซึ่งเป็น AI ตัวก่อนหน้านี้ของบริษัท

Key Takeaways

- Runway ได้เปิดตัว AI Video Generator รุ่นใหม่ล่าสุด Gen-3 ซึ่งมีความก้าวหน้าอย่างมากในด้านความสมจริง ความสอดคล้อง และการปฏิบัติตาม prompt เมื่อเทียบกับรุ่นก่อนหน้า

- ผู้ใช้งานชื่นชม Gen-3 ว่าสร้างวิดีโอที่ดูสมจริงมาก โดยเฉพาะใบหน้ามนุษย์ บางคนเห็นว่าดีกว่า Sora ของOpenAI ซึ่งยังไม่ได้เปิดตัว

- Gen-3 จะขับเคลื่อนเครื่องมือต่างๆ ของ Runway และมีแผนเพิ่มความสามารถในการควบคุมโครงสร้างสไตล์ และการเคลื่อนไหวได้ละเอียดขึ้น โดยมีเป้าหมายสร้าง “General World Models” ที่ทำให้ AI จำลองเหตุการณ์ในอนาคตได้

- คู่แข่งในตลาด AI Video Generator มีมากขึ้น ทั้ง Sora, Kling, Dream Machine รวมถึงโมเดลโอเพ่นซอร์สอย่าง Stable Video Diffusion และ Vidu แต่ Runway ยังคงเป็นผู้นำในด้านคุณภาพและความสามารถ

บริษัท Runway ผู้นำด้าน AI ที่มีชื่อเสียงจากเครื่องมือสร้างวิดีโอ (generative video tool) ได้เปิดตัว Runway Gen-3 รุ่นใหม่ล่าสุด ซึ่งยังอยู่ในช่วง alpha และยังไม่เปิดให้ใช้งานสาธารณะ โดยได้มีการสาธิตผ่านตัวอย่างวิดีโอที่แสดงให้เห็นถึงความก้าวหน้าอย่างมากในด้านความสอดคล้อง ความสมจริง และการปฏิบัติตาม prompt เมื่อเทียบกับ Gen-2 ที่ใช้งานอยู่ในปัจจุบัน

วิดีโอที่สร้างขึ้น โดยเฉพาะอย่างยิ่งที่มีใบหน้ามนุษย์ มีความสมจริงสูงมาก จนสมาชิกในชุมชน AI art รีบเปรียบเทียบในทางที่ดีกับ Sora ของ OpenAI ซึ่งยังไม่ได้เปิดตัวแต่ก็เป็นที่คาดหวังอย่างสูง

“ถึงแม้ว่าจะเป็นการเลือกสรรมาแล้ว แต่ก็ยังดูดีกว่า Sora อยู่ดี” ผู้ใช้ Reddit รายหนึ่งเขียนในความคิดเห็นที่ได้รับโหวตสูงสุดในกระทู้อภิปราย Runway Gen-3 “Sora มีลักษณะและความรู้สึกที่ดัดแปลงไปจากความเป็นจริง” ผู้ใช้อีกรายหนึ่งตอบ “คนเหล่านี้ดูเหมือนจริง ดีที่สุดที่ผมเคยเห็นมา“

“ถ้าคุณแสดงภาพคนที่สร้างขึ้นเหล่านี้ให้ผมดู ผมคงคิดว่ามันเป็นของจริง” ความเห็นอื่น ๆ ใน AI Video subreddit ที่มีสมาชิก 66,000 คนระบุ

“คลิป Runway GEN-3 เหล่านี้มีความน่าสนใจทางภาพอย่างมากสำหรับผม – พวกเขาดูเหมือนหนังเลย” PZF ผู้สร้างภาพยนตร์ AI นามแฝง ซึ่งระบุตัวเองเป็นพันธมิตรด้านความคิดสร้างสรรค์ของ Runway ทวีต “นุ่มนวล เรียบง่าย (ในความหมายที่ดี เป็นธรรมชาติ) และน่าเชื่อถือ“

นอกเหนือจาก text-to-video generator รุ่น Gen-3 แล้ว Runway ยังนำเสนอชุดเครื่องมือ fine-tuning รวมถึงการควบคุมภาพและกล้องที่ยืดหยุ่นมากขึ้น

“Gen-3 Alpha จะขับเคลื่อน text-to-video, image-to-video และ text-to-image tools ของ Runway, รวมถึงcontrol modes ที่มีอยู่เดิม เช่น Motion Brush, Advanced Camera Controls และ Director Mode ตลอดจนเครื่องมือที่กำลังจะมาถึงเพื่อให้สามารถควบคุมโครงสร้าง สไตล์ และการเคลื่อนไหวได้ละเอียดยิ่งขึ้น” บริษัทโพสต์ทวีต

Runway อ้างว่า Gen-3 เป็นก้าวสำคัญในการทำให้เป้าหมายอันทะเยอทะยานของพวกเขาในการสร้าง “General World Models” เป็นจริง โมเดลเหล่านี้จะทำให้ระบบ AI สามารถสร้างการแสดงแทนภายในของสภาพแวดล้อมและใช้มันเพื่อจำลองเหตุการณ์ในอนาคตภายในสภาพแวดล้อมนั้น วิธีการนี้จะทำให้ Runway แตกต่างจากเทคนิคทั่วไปที่มุ่งเน้นไปที่การทำนายเฟรมถัดไปที่น่าจะเกิดขึ้นในไทม์ไลน์เฉพาะ

แม้ว่า Runway จะไม่ได้เปิดเผยวันที่เปิดตัว Gen-3 โดยเฉพาะ แต่ Anastasis Germanidis ผู้ร่วมก่อตั้งและ CTO ประกาศว่า Gen-3 Alpha “จะเปิดให้ใช้งานใน Runway product ในเร็วๆ นี้” ซึ่งรวมถึงโหมดที่มีอยู่ รวมทั้ง“โหมดใหม่บางอย่างที่เป็นไปได้เฉพาะกับ base model ที่มีความสามารถมากขึ้นเท่านั้น” เขาเกริ่นไว้

การเดินทางของ Runway ในโลก AI เริ่มต้นขึ้นในปี 2021 เมื่อพวกเขาร่วมมือกับนักวิจัยจากมหาวิทยาลัยมิวนิคเพื่อสร้าง Stable Diffusion เวอร์ชันแรก ต่อมา Stability AI ได้เข้ามาชดเชยค่าใช้จ่ายด้านการคำนวณของโครงการและเปลี่ยนให้กลายเป็นปรากฏการณ์ระดับโลก

นับแต่นั้นมา Runway ก็เป็นผู้เล่นสำคัญในวงการ AI video generation ควบคู่ไปกับคู่แข่งอย่าง Pika Labs อย่างไรก็ตาม landscape ก็เริ่มเปลี่ยนไปเมื่อ OpenAI ประกาศเปิดตัว Sora ซึ่งมีความสามารถเหนือกว่าโมเดลที่มีอยู่ Ashton Kutcher นักแสดงฮอลลีวูดเพิ่งสร้างความฮือฮาเมื่อเขากล่าวว่าเครื่องมือเช่น Sora สามารถพลิกโฉมการผลิตรายการโทรทัศน์และภาพยนตร์ได้อย่างมหาศาล

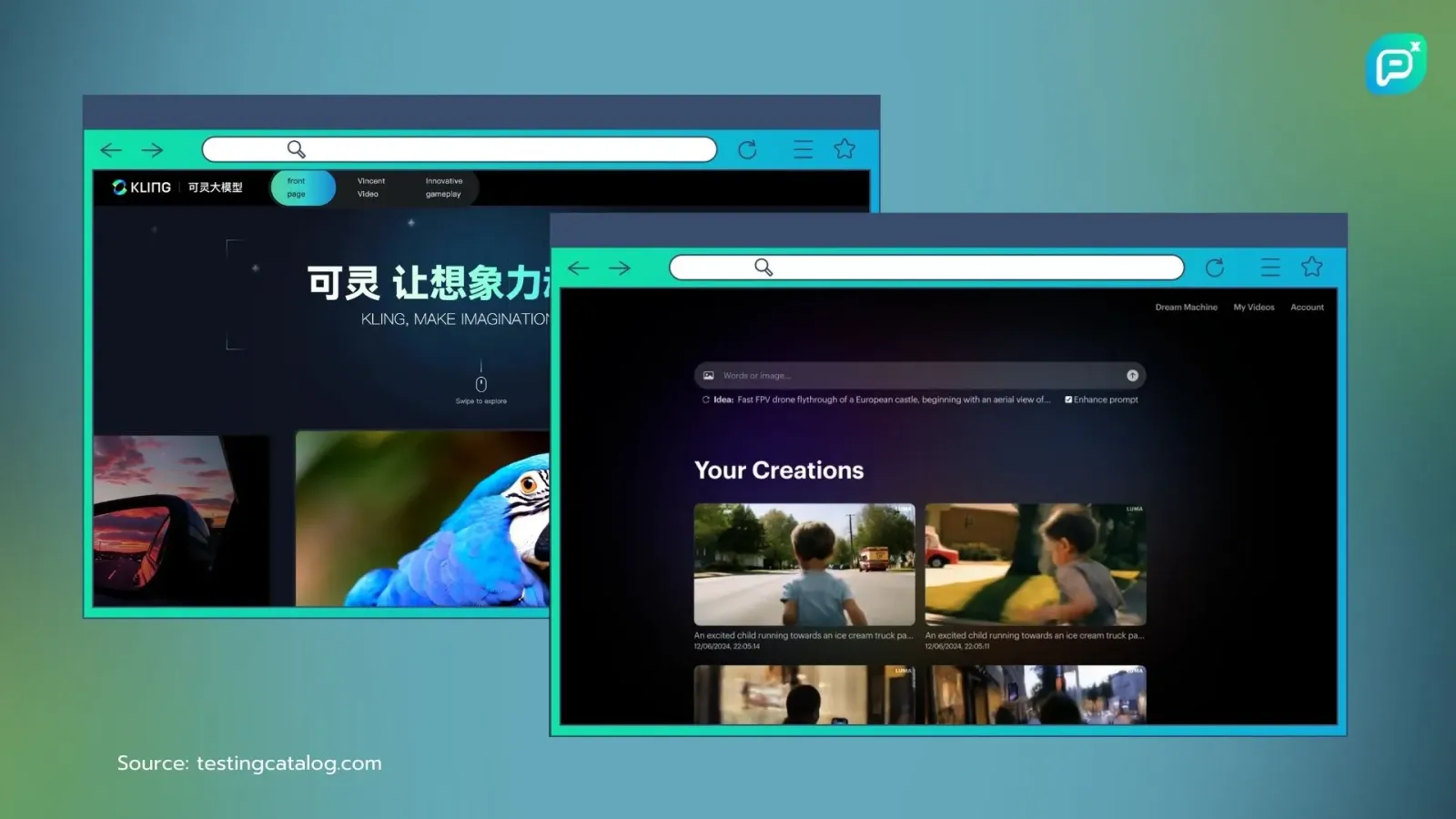

อย่างไรก็ตาม ในขณะที่โลกรอคอยการเปิดตัว Sora สู่สาธารณะ คู่แข่งรายใหม่ก็ได้ปรากฏตัวขึ้น เช่น Kling ของKuaishou และ Dream Machine ของ Luma AI

Kling ผู้ผลิตวิดีโอชาวจีน สามารถสร้างวิดีโอความยาวได้ถึงสองนาทีในความละเอียด 1080p ที่ 30 เฟรมต่อวินาทีซึ่งเป็นการปรับปรุงอย่างมากเมื่อเทียบกับโมเดลที่มีอยู่ โมเดลจีนนี้ใช้งานได้แล้ว แต่ผู้ใช้ต้องระบุหมายเลขโทรศัพท์ของจีน Kuaishou กล่าวว่าจะเปิดตัวเวอร์ชัน global

ในทางกลับกัน Dream Machine เป็นแพลตฟอร์มใช้งานฟรีที่แปลงข้อความเป็นวิดีโอแบบไดนามิก และให้ผลลัพธ์ที่เอาชนะ Runway Gen-2 ได้อย่างง่ายดายในแง่ของคุณภาพ ความสอดคล้อง และการปฏิบัติตาม prompt มันต้องการบัญชี Google ขั้นพื้นฐาน แต่ได้รับความนิยมมากจนการสร้างใช้เวลานานมาก – ถ้ามันเกิดขึ้นได้จริงน่ะนะ

ในด้านโอเพ่นซอร์ส Stable Video Diffusion แม้จะยังไม่สามารถสร้างผลลัพธ์ที่เทียบเคียงได้ แต่ก็มีพื้นฐานที่มั่นคงสำหรับการปรับปรุงและพัฒนา Vidu ซึ่งเป็นอีกหนึ่ง AI video generator ของจีนที่พัฒนาโดย ShengShu Technology และ Tsinghua University ใช้สถาปัตยกรรมโมเดลการแปลงภาพเฉพาะที่เรียกว่า Universal Vision Transformer (U-ViT) เพื่อสร้างวิดีโอความยาว 16 วินาทีในความละเอียด 1080p ด้วยการคลิกเพียงครั้งเดียว

ส่วน Pika Labs ยังไม่ได้ปล่อยอัปเดตใหญ่ ทำให้ความสามารถยังคงเทียบเท่ากับ Runway Gen-2 อยู่